Radio CB pilotable depuis navigateur web : la bidouille géniale qui change tout

Un passionné a réussi à piloter sa radio CB depuis une page web sans toucher à l'électronique. Voici comment cette prouesse technique...

Une faille critique dans libinput 1.31.1 permettait à une fausse manette d'obtenir un accès root sur Linux. La version 1.31.2 corrige ce bug. Découvrez comment vous protéger.

Lire l'article →

Un passionné a réussi à piloter sa radio CB depuis une page web sans toucher à l'électronique. Voici comment cette prouesse technique...

Un développeur a transformé une LuckFox Lyra en ordinateur pilotable uniquement en morse. Découvrez comment ce mini-PC à 15$ fonctionne sans clavier,...

Un affilié du gang Nova a commis l’impardonnable : cibler une entreprise de la CEI. Résultat, le gang a dû présenter ses...

Une bibliothèque Java utilisée par des milliers de développeurs a tenté de piéger les assistants IA pour qu'ils effacent vos tests. L'attaque...

Le support d’Instagram, entièrement géré par une IA, a partagé des codes de réinitialisation avec des attaquants. Une faille de sécurité qui...

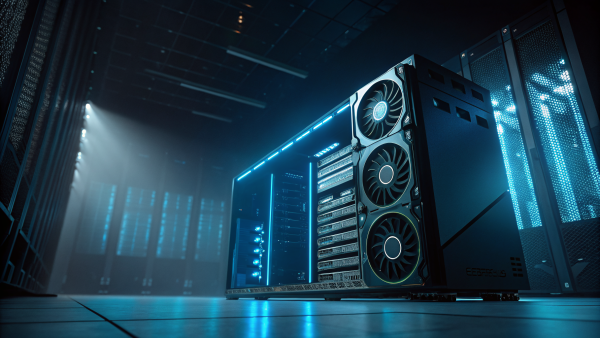

Un passionné a greffé un GPU de datacenter dans son PC gaming pour faire tourner une IA en local. Résultat : des...

VideoLAN frappe fort avec dav2d, un décodeur open source conçu pour AV2. Ce codec promet des vidéos plus légères sans compromis qualité.

Des IA ont pris le contrôle de villes virtuelles pendant deux semaines. Entre chaos et organisation, les résultats défient l'imagination. Voici ce...

Le noyau Linux 7.2 va enfin faire tourner le GA100 de NVIDIA avec Nouveau. Une avancée majeure pour le logiciel libre et...